거대언어모델

본 서비스가 제공하는 내용 및 자료가 사실임을 보증하지 않습니다. 시스템은 언제나 실수를 할 수 있습니다. 중요한 의사결정 및 법리적 해석, 금전적 의사결정에 사용하지 마십시오.

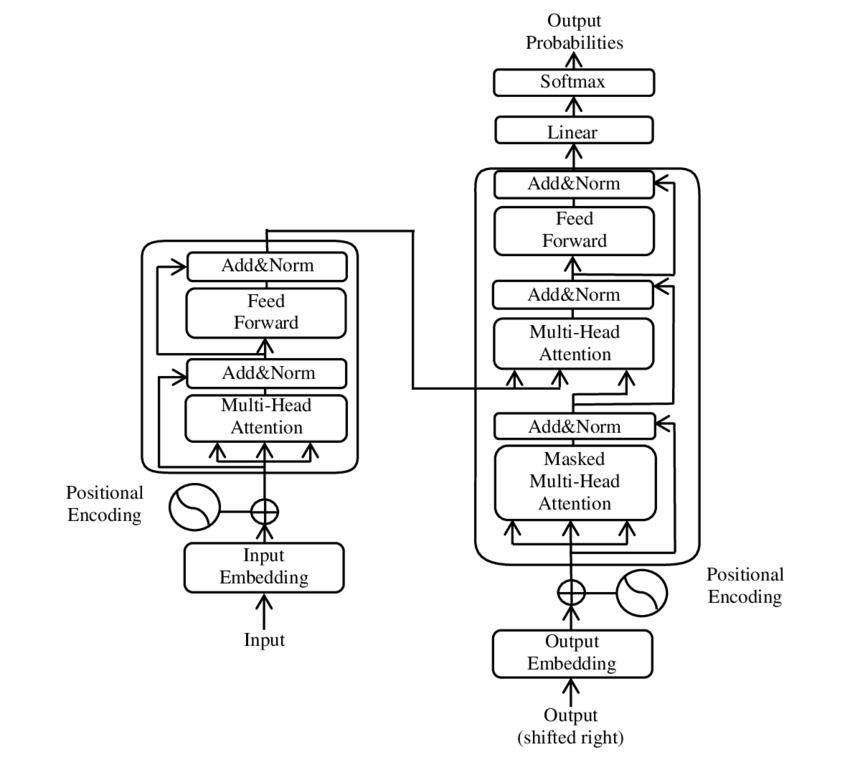

거대언어모델(Large Language Model, LLM)은 수많은 매개변수(Parameter)를 보유한 인공 신경망 기반의 언어 모델이다. 방대한 양의 데이터 세트를 학습하여 콘텐츠를 인식, 요약, 번역, 예측 및 생성하는 기능을 수행한다. 2017년 발표된 트랜스포머(Transformer) 아키텍처를 주요 기반으로 하며, 2018년경부터 본격적으로 등장하여 자연어 처리 연구의 중심이 되었다. 기존의 특정 작업에 특화된 지도 학습 모델과 달리, 대규모 텍스트 데이터를 통한 자기 지도 학습을 통해 범용적인 언어 능력을 확보한다.

개요

거대언어모델은 인공지능 챗봇 기술을 가능하게 하는 핵심 요소이다. 이는 인간의 언어를 기계가 이해할 수 있는 방식으로 처리하며, 문장의 구조를 예측하여 자연스러운 텍스트를 생성한다. 기존의 검색 엔진이 키워드 일치 방식에 의존했다면, 거대언어모델은 문맥과 뉘앙스, 추론을 포착하여 보다 깊이 있는 언어 처리를 수행한다.

기술적 특징

거대언어모델의 성능은 방대한 매개변수와 맥락 파악 능력에서 기인한다. 주요 특징은 다음과 같다.

- 트랜스포머 아키텍처: 2017년 구글이 발표한 구조로, 순차적 데이터 내의 관계를 추적하여 의미를 학습한다.

- 셀프 어텐션(Self-attention): 입력 데이터의 각 부분에 가중치를 할당하여, 중요한 정보에 집중하고 맥락을 파악하는 기술이다.

- 위치 인코딩(Positional Encoding): 문장 내 단어의 순서 정보를 임베딩하여, 단어가 비순차적으로 입력되더라도 위치 관계를 이해할 수 있게 한다.

작동 원리

모델의 작동 방식은 크게 토큰화, 트랜스포머 모델 처리, 프롬프트 수행으로 나뉜다.

- 토큰화(Tokenization): 인간의 언어를 기계 시스템이 이해할 수 있는 단위인 토큰(단어, 부분 단어, 문자 등)으로 변환하고 숫자 값을 할당하는 과정이다.

- 예측 메커니즘: 거대언어모델은 거대한 통계 예측 기계로 작동한다. 시퀀스 내의 다음 토큰이 무엇이 될지 반복적으로 예측하며 텍스트를 생성한다.

- 컨텍스트 벡터 생성: 언어의 구조를 이해하고 문장이 어떻게 구성되는지 학습하여 정확한 예측을 위한 가이드를 생성한다.

학습 및 응용

거대언어모델은 레이블링되지 않은 대규모 텍스트 데이터를 사용하여 자기 지도 학습을 수행한다. 학습이 완료된 모델은 다음과 같은 다양한 분야에 응용된다.

- 콘텐츠 생성: 기사 작성, 코드 디버깅, 법률 조항 초안 작성 등.

- 정보 요약 및 번역: 긴 문서를 요약하거나 서로 다른 언어 간의 번역 수행.

- 자율 에이전트: 인간의 개입 없이 특정 작업을 수행하는 자율 시스템의 기반이 된다.

주요 모델 사례

다양한 기업과 연구소에서 거대언어모델을 개발하여 공개하고 있다.

| 모델명 | 개발사 | 특징 |

|---|---|---|

| DBRX | 데이터브릭스 | 1,320억 개의 매개변수를 가진 오픈 소스 전문가 혼합 모델 |

| LLaMA | 메타(Meta) | 주요 오픈 소스 거대언어모델 시리즈 |

| Grok | xAI | 일론 머스크의 인공지능 기업에서 개발한 모델 |

| Mixtral | 미스트랄 AI | 효율적인 성능을 강조한 유럽 기반의 모델 |