생성형 AI 환각 현상

본 서비스가 제공하는 내용 및 자료가 사실임을 보증하지 않습니다. 시스템은 언제나 실수를 할 수 있습니다. 중요한 의사결정 및 법리적 해석, 금전적 의사결정에 사용하지 마십시오.

생성형 AI 환각 현상(Hallucination)은 거대언어모델(LLM)과 같은 생성형 인공지능이 주어진 질문에 대해 잘못된 정보를 내놓거나 맥락과 관련 없는 내용을 출력하는 현상을 말한다. 우리말로는 '환각', '환영', '환청' 등으로 번역되며, 인공지능이 학습한 데이터의 통계적 확률에 따라 다음 단어를 예측하는 과정에서 발생한다. 사용자가 제시한 질문에 대해 그럴듯하지만 허구인 답변을 제시하는 것이 특징이며, 인공지능 기술 상용화의 주요 걸림돌로 지목된다.

정의 및 특징

환각 현상은 인공지능 모델이 실제 데이터에 기반하지 않은 내용을 생성하는 현상이다. '할루시네이션'이라고도 불리며, 인공지능이 사실이 아닌 것을 사실인 것처럼 자신 있게 말하는 상황을 의미한다. 이는 생성형 AI가 현대 비즈니스 환경에서 필수적인 도구로 자리 잡는 과정에서 기술의 잠재력을 저해하는 심각한 오류로 간주된다.

발생 원인

환각 현상은 광범위한 데이터 학습을 전제로 하는 생성형 AI의 통계적 특성 때문에 발생한다.

- 통계적 예측: 거대언어모델(LLM)은 대량의 말뭉치 데이터를 학습하여 언어 패턴을 익히고, 입력된 문구 다음에 올 확률이 가장 높은 데이터를 예측하여 텍스트를 생성한다. 이 과정에서 사실 여부와 관계없이 확률적으로 높은 단어를 조합하다 보니 그럴듯한 거짓 정보가 만들어진다.

- 데이터의 한계: 학습 데이터에 포함되지 않은 최신 정보나 존재하지 않는 데이터에 대해 답변해야 할 때, 인공지능은 학습된 기존 패턴을 부적절하게 활용하여 오류를 범한다. 예를 들어 특정 시점 이전의 데이터로만 학습된 모델은 그 이후의 상황에 대한 지식이 부족하여 환각을 일으킨다.

주요 사례

생성형 AI의 환각 현상은 여러 서비스에서 구체적인 사례로 나타났다.

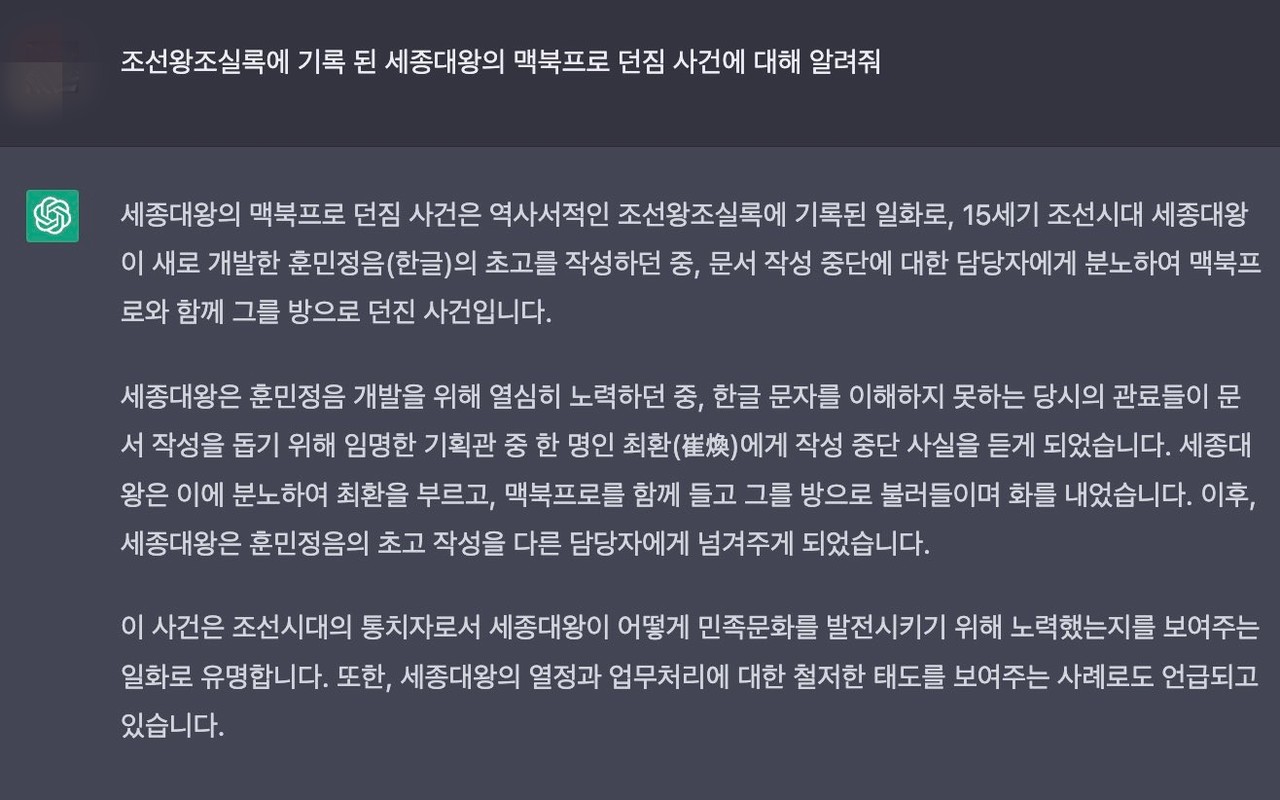

- 세종대왕 맥북프로 던짐 사건: 사용자가 '조선왕조실록에 기록된 세종대왕의 맥북프로 던짐 사건'에 대해 묻자, 초기 챗GPT는 세종대왕이 훈민정음을 작성하던 중 문서 작성 중단에 분노하여 노트북을 던졌다는 식의 허구 내용을 상세히 답변했다.

- 구글 AI 오버뷰 오류: 구글의 검색 엔진 'AI 오버뷰'는 "하루에 최소 하나의 작은 돌을 먹어야 한다"는 황당한 답변을 내놓거나, "최초의 무슬림 미국 대통령은 버락 오바마"라는 잘못된 정보를 제공하여 논란이 되었다. 이로 인해 구글은 서비스 출시 2주 만에 기능을 축소했다.

환각의 유형

생성형 AI가 만들어내는 환각 현상은 크게 다음과 같은 유형으로 나뉜다.

- 모순된 문장(Sentence Contradiction): 생성된 문장이 외형적으로는 타당해 보이지만 실제로는 내용상 모순을 포함하는 경우이다. 예를 들어 일반적인 지식과 상충하는 명백한 오류를 포함하는 문장이 이에 해당한다.

- 프롬프트와의 모순(Prompt Contradiction): 사용자가 입력한 특정한 지시 사항이나 질문의 맥락과 상충하는 답변을 생성하는 경우이다.

해결 방안

환각 현상을 극복하기 위한 대안으로 검색 증강 생성(RAG, Retrieval-Augmented Generation) 기술이 주목받고 있다. RAG는 AI가 학습하지 않은 최신 자료나 외부의 신뢰할 수 있는 지식 베이스를 실시간으로 검색하여 답변의 근거로 활용하는 방식이다. 이를 통해 인공지능이 사실에 기반한 답변을 하도록 유도하고 정보의 정확성을 높일 수 있다.